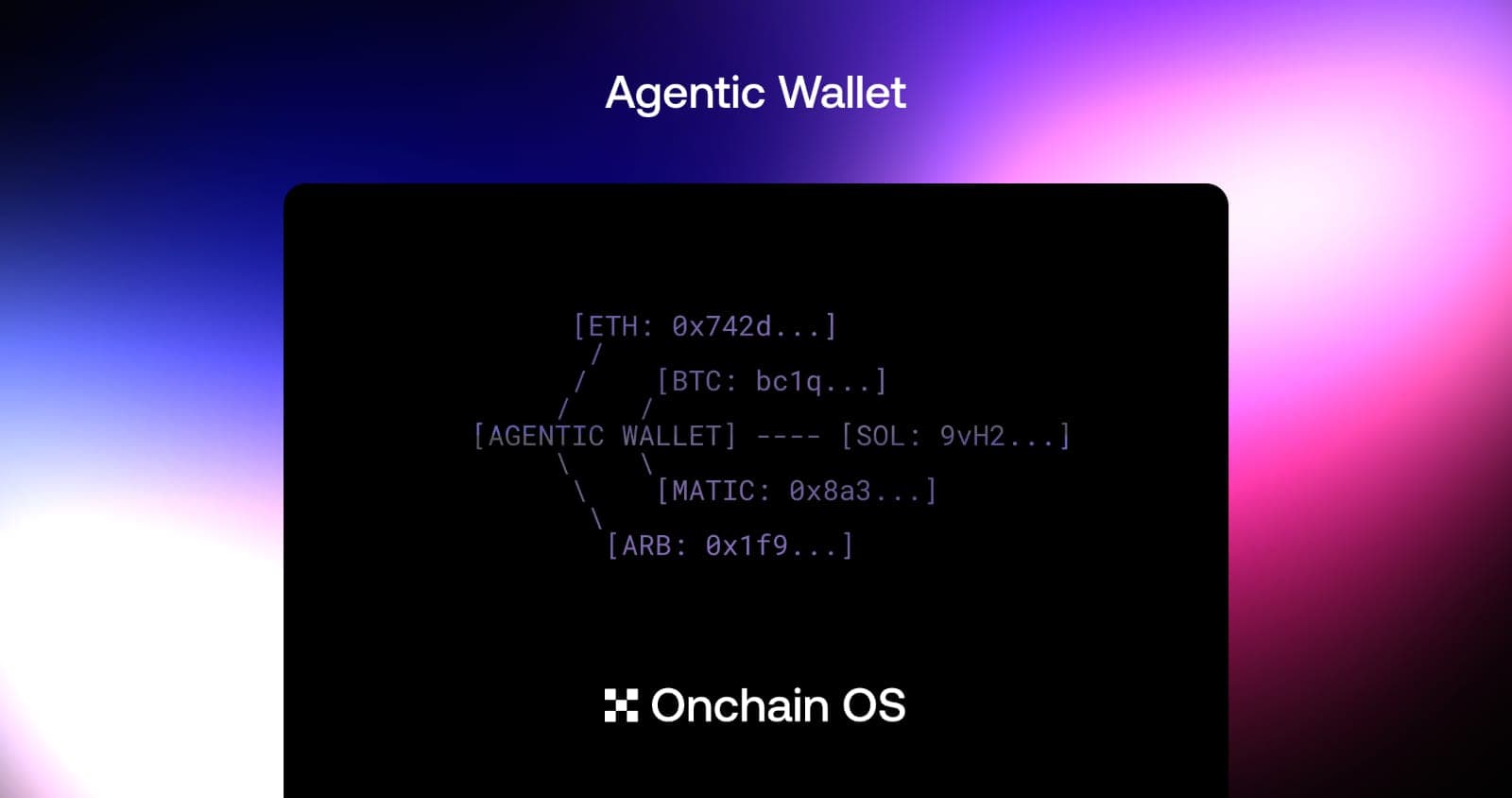

مجموعة Apex تخطط لإدارة أصول ممثلة رقمياً بقيمة 100 مليار دولار عبر T-REX Ledger

Apex Group تعتمد منصة T-REX Ledger لتوسيع نطاق إدارة الأصول الرقمية إلى 100 مليار دولار، مع ضمان الامتثال عبر سلاسل متعددة وحوكمة موثوقة…

مجموعة Apex تخطط لإدارة أصول ممثلة رقمياً بقيمة 100 مليار دولار عبر T-REX Ledger

Apex Group تعتمد منصة T-REX Ledger لتوسيع نطاق إدارة الأصول الرقمية إلى 100 مليار دولار، مع ضمان الامتثال عبر سلاسل متعددة وحوكمة موثوقة…